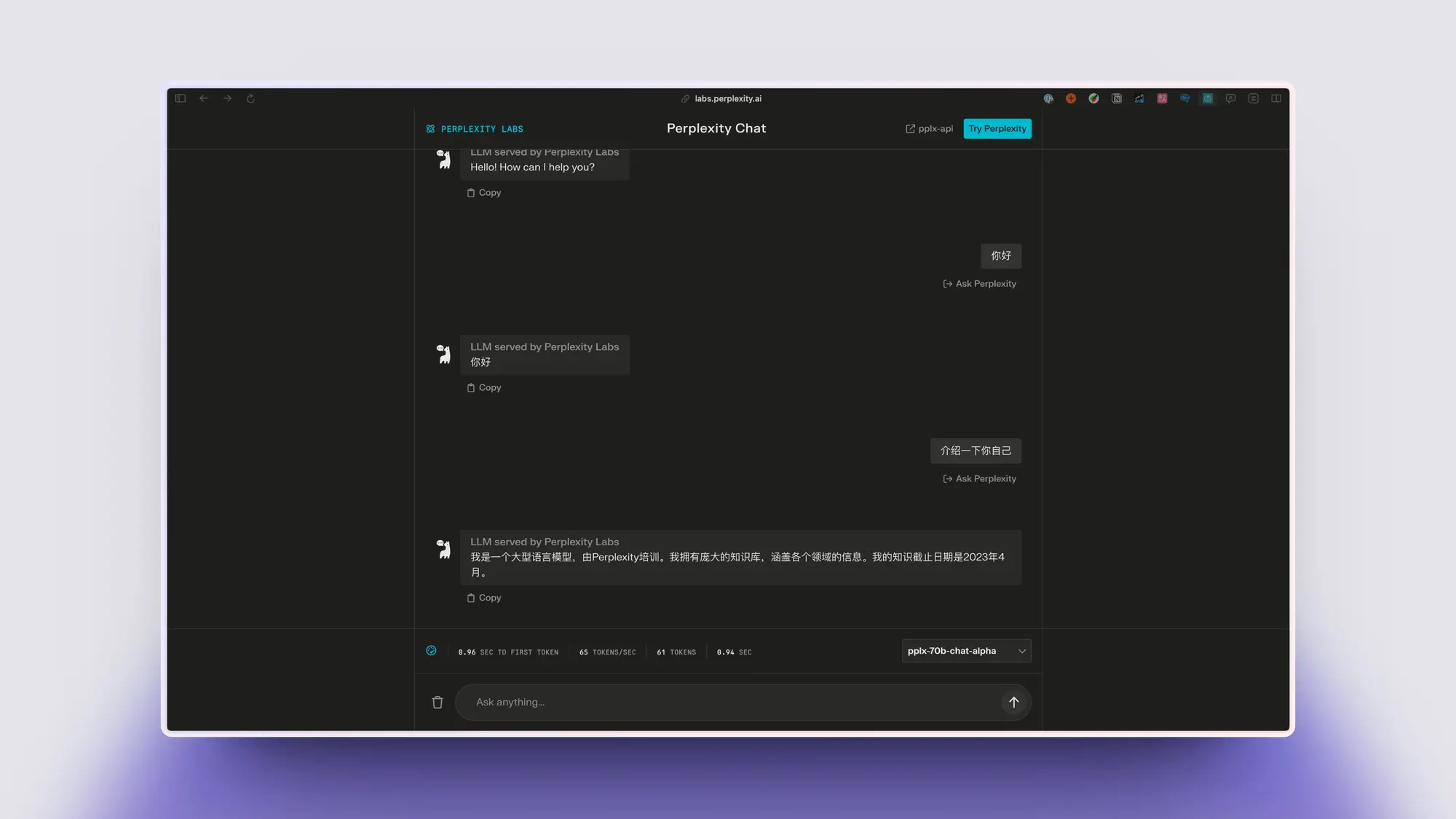

Perplexity还是开始自己训练模型了,公布了自己训练的两个pplx-7b-chat 和 pplx-70b-chat模型。

主要的特点是优先保证一系列任务的智力、有用性和多功能性,而不强加道德判断或限制。

与llama-2-70b-chat相比较完全拒绝”的情况减少了22.7%,而“没有拒绝”的情况增加了31.9%。

估计是被 Open AI 和 Claude 2的各种拒绝回答搞麻了,他们做搜索和一些 Agents 功能确实比较烦这种。

同时上周Perplexity 新获得 5000 万美元融资,目前估值为 5 亿美元。风险投资公司IVP领投。

未经允许不得转载:表盘吧 » Perplexity发布自己训练的模型