在大型语言模型和聊天机器人领域,响应流已成为一种流行的功能,提供了逐个令牌或逐字加载输出的能力。使用户能够在聊天机器人处理时读取其结果。例如,当您在 ChatGPT 中输入提示时,您将看到单词开始出现,因为 ChatGPT 开始通过其 Web 界面将其响应流式传输给您。

这对于数据量可能不堪重负的大型文本生成任务特别有用。本文将深入探讨使用LangChain为大型语言模型和聊天机器人实现流媒体的复杂性,重点是通过LangChain的ChatOpenAI对象使用OpenAI的ChatGPT-3.5-turbo模型。

最简单的流式处理是一个允许将数据处理为稳定和连续流的过程。这与传统的数据处理方法形成鲜明对比,在传统的数据处理方法中,所有数据都必须加载到内存中,然后才能进行处理。流式处理的好处是多方面的,包括提高效率、减少内存使用以及实时处理大量数据的能力。

聊天GPT响应流

对于基本用例,实现响应流式处理可能很简单。但是,在集成 LangChain 和代理时,或者将数据从代理流式传输到 API 时,复杂性会增加。这是由于代理在语言模型周围添加了额外的逻辑层。

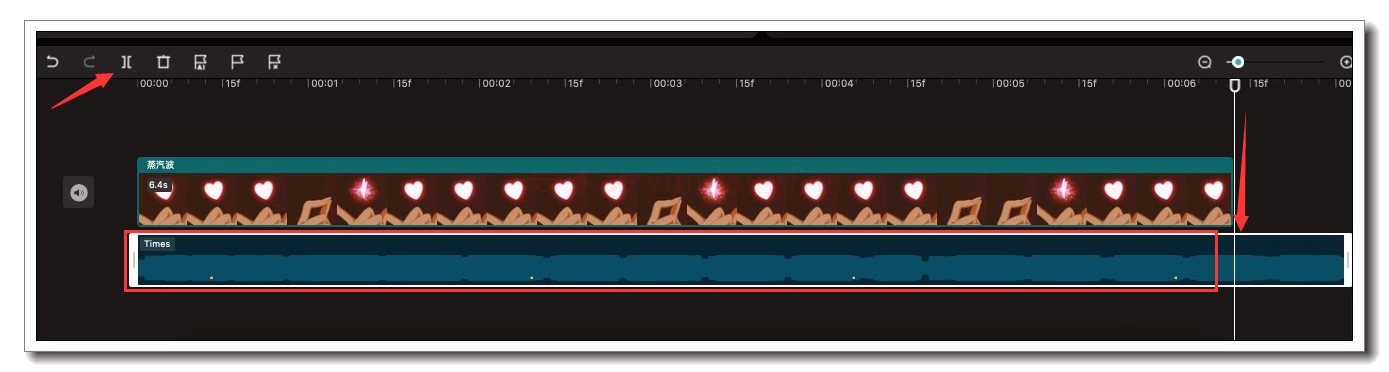

在 LangChain 中,在初始化语言模型时可以使用两个参数来启用流式处理:“流式处理”和“回调”。“streaming”参数激活流式处理,而“回调”参数管理流式处理过程。可以通过观察每个新生成的令牌的输出来监视流式处理过程。观看下面由 James Briggs 创建的精彩视频,他提供了一个精彩的介绍和起点,帮助您使用 FastAPI 立即将其部署到生产中。

在 LangChain 中使用代理时,代理以 JSON 格式返回语言模型的输出。此输出可用于提取工具或最终答案。LangChain 有一个内置的回调处理程序,用于输出代理的最终答案。但是,为了获得更大的灵活性,还可以使用自定义回调处理程序。

可以将自定义回调处理程序设置为在到达最终答案部分后开始流式传输。这提供了对流式处理过程的更精细的控制,允许开发人员根据其特定需求定制流式处理输出。

要使用 API 实现流式处理,需要一个流式处理响应对象。这需要运行代理逻辑和循环,以便同时通过 API 传递令牌。这可以通过使用异步函数并创建一个生成器来实现,该生成器在令牌通过 API 传递时在后台运行代理逻辑。

可以修改自定义回调处理程序,以便在流式处理时仅返回代理输出的所需部分。这允许更有针对性的流式处理输出,从而减少流式传输的不必要数据量。

然而,使用 LangChain 和代理实现流媒体并非没有挑战。可能需要其他测试和逻辑来处理代理未生成预期输出的情况。这可能涉及创建自定义错误处理逻辑,或实施其他检查以确保输出符合预期。

使用 LangChain 为大型语言模型和聊天机器人实现响应流是一个复杂但有益的过程。它提供了许多好处,包括提高效率、减少内存使用以及实时处理大量数据的能力。然而,它也带来了挑战,特别是在集成LangChain和代理时,或者在将数据从代理流式传输到API时。通过仔细的规划和测试,可以克服这些挑战,从而实现强大而高效的流式处理实现。

未经允许不得转载:表盘吧 » ChatGPT-3.5-Turbo 响应流,适用于 LangChain AI 代理